英语原文共 8 页,剩余内容已隐藏,支付完成后下载完整资料

开发与传感器网络集成的智能机器人

摘要

为了开发一个具有类似人类存在的机器人,机器人必须具有非常人性化的外观和行为,以及能够与人类交流的感知能力。 我们开发了一款名为“Repliee Q2”的机器人,它非常类似于人类; 然而,由于诸如感测范围和空间分辨率的因素,安装在其身体上的传感器不足以允许类似人的通信。 为了克服这个问题,我们通过在其中嵌入各种传感器来赋予围绕智能机器人具有感知能力的环境。 这个传感器网络通过持续和广泛地以不太明显的方式广泛监控人类活动,为智能机器人提供了类似于人类的感知。 本文报道了一个与嵌入环境中的传感器网络系统集成的安卓系统。 人机交互实验表明,集成系统提供了相对人性化的交互。

1.简要介绍

近年来,人类机器人在日常生活中与人类有交互作用的研究和开发,因为许多机器人任务需要类似人的存在,即在日常生活中与人类交流。装备有类似人的存在的机器人能够实现自然的人机交互,也就是说,人能够自然地与机器人通信,就好像他正在与另一个人通信一样。学习给人类机器人呈现给机器人的原则的一种方法是开发一种能够感知和行为像人类一样的机器人。开发这样的机器人将揭示人类存在的原则。

为了开发一种能够通过沟通渠道自然地与人交流的机器人,我们必须解决以下问题。

bull;必须为机器人提供非常人性化的外观和动作,以便与人类进行社交互动

bull;必须为机器人提供感知功能,通过人工通信渠道与人类进行通信。

然而,为了实现自然的人机交流,需要人类自然的程度和需要多少知觉还没有被揭示。我们一直在对这些问题进行研究,以探索使用具有非常人性化外观的机器人来实现自然人机交互的原理,这种机器人被称为“机器人”[5] D机器人的人类外观必须充分拟人化以引发自然的人际关系反应[6]。因此,对智能机器人在外观和运动方面的类人性质进行了研究,并且他们表明,类似于人的存在是在短时间交互或与受限上下文交互的情况下实现的[7]。然而,智能机器人系统还不足以在更广泛的情况下实现类人性,因为在这些研究中,机器人的感知功能没有被实验人员实现或取代。为了阐明自然通信所需的感知功能,我们试图用智能机器人来实现人类的感知。

机器人的沟通能力得到了提高

通过使用内置传感器实现与人类相同的感知(例如,[8])。但是,内置传感器在范围和分辨率方面有很多限制,并且会对自然通信造成困难。

有一种为环境本身提供感知功能的技术,即将传感器嵌入环境中[9] [10] [11]。这样的系统与人类感知系统完全不同,但是如果机器人假装认识到人类即使实际上没有感知到,自然通信也是可能的。

在这项研究中,为了消除内置传感器的限制并实现与人类的自然通信,我们提出了一个相当新的机器人传感器系统。该系统使用尽可能多种类的传感器实现感知和安卓操作,不仅包括嵌入环境中的传感器,还包括内置传感器。这在本文中被称为“传感器网络”。通过在人机界面上增加各种高效的感应系统,可以实现世界上第一个类人机器人系统,它可以实现一个融合外观,动作和感知的人性化自然。

传感器网络为机器人提供了与人类完全不同的感知形式。然而,这种模式对于类似人类的看法并不重要。这意味着系统需要选择适合当前适合自然通信的情况的感官信息。例如,人通过使用视觉或音频传感器(例如,眼睛或耳朵)发现其他人在哪里,但是用于类人交互的最重要的信息是位置(例如情况)。然后,为了便于处理与情境相关的信息,系统准备各种运动模块,其中每个模块将感觉信息与智能机器人手势进行绑定

本文报告了通信系统的发展,以便将环境中嵌入的传感器与智能机器人相结合。

在本文中,为了表明我们开发的系统可以通过机器人实现自然的人类行为,我们进行了评估印象的实验。我们专注于安静地坐着的情况。这种情况已经在以前的研究中得到实施和评估[6] [7]。但是这些研究没有使用感官信息。为了使智能机器人行为更像人类,反应行为(例如,当一个人出现时,智能机器人会将头转向人)必须是必要的。在实验中,受试者比较两种安卓运动。一个是智能机器人根据感官信息显示反应的动作,另一个是智能机器人不依赖感官信息并随机选择动作的地方

在本文中,首先我们解释硬件组成以及我们在第二章中开发的系统的软件架构。 接下来,我们将在第三章中报告上述验证实验的结果。

一种与传感器网络集成的机器人系统

- 硬件组成

在智能机器人的环境中,安排了全向摄像头,麦克风,云台摄像机和地面触觉传感器。 触觉皮肤传感器内置于机器人的主体内。 这些传感器连接到传感器处理计算机,感知信息通过TCP / IP在相互连接的计算机之间传输(图3)。 在下文中,首先描述智能机器人的规格,然后给出每个传感器的规格和感官信息处理。

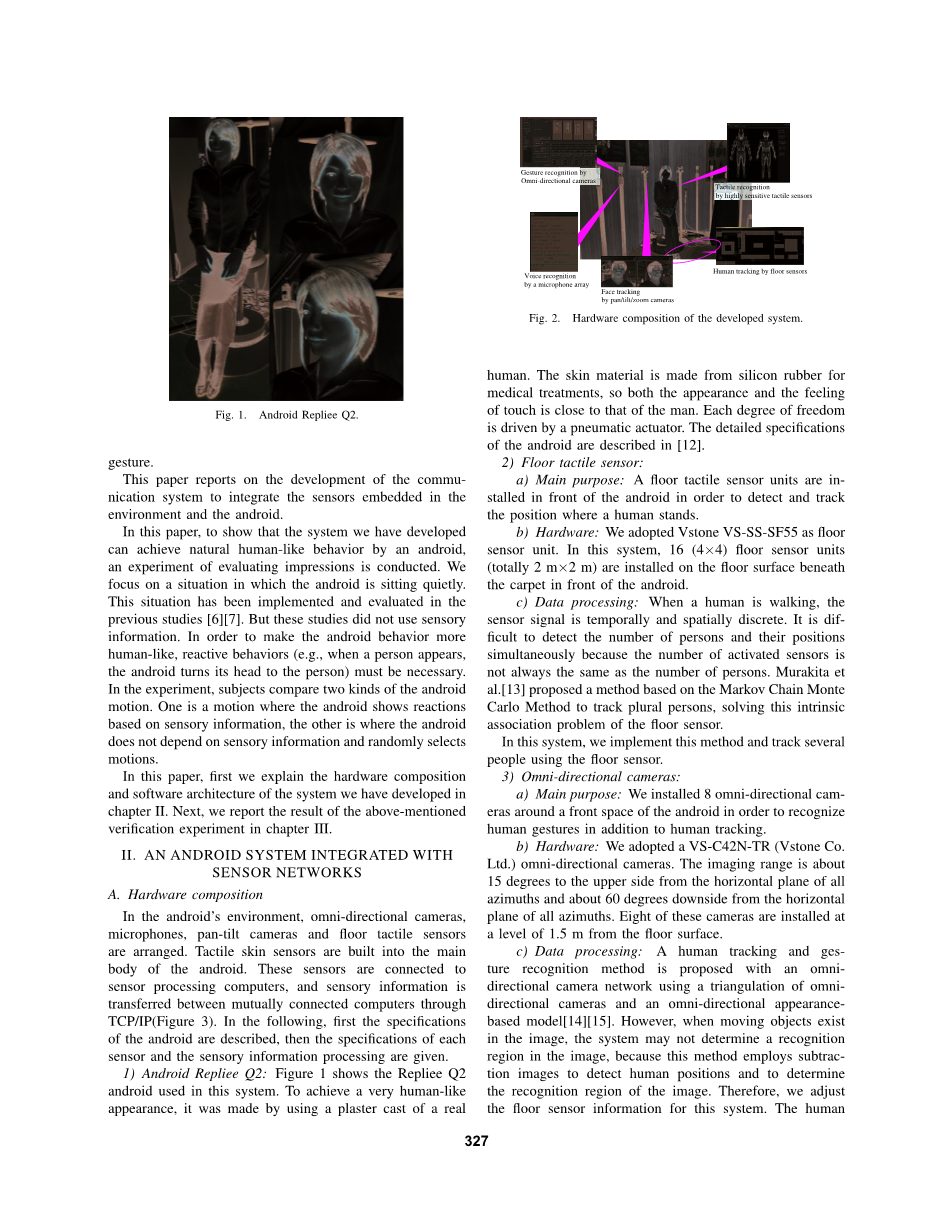

- 智能机器人 Repliee Q2:图1显示了该系统中使用的Repliee Q2 智能机器人。 为了达到非常人性化的外观,它是通过使用真人的石膏模型制成的。 皮肤材料由硅橡胶制成,用于治疗,因此外观和触感与人的接近。 每个自由度都由气动执行机构驱动。 在[12]中描述了智能机器人的详细规范。

图1 机器人Repliee Q2

图2 完善系统的硬件组成

2)地板触觉传感器:

a)主要目的:地面触觉传感器单元安装在机器人前面,以便检测和跟踪人类站立的位置。

b)硬件:我们采用Vstone VS-SS-SF55作为地板传感器单元。 在此系统中,机器人前方的地毯下方的地板表面上安装了16(4times;4)个地板传感器单元(总计2米times;2米)。

c)数据处理:当人在行走时,传感器信号在时间和空间上是离散的。由于激活的传感器的数量并不总是与人数相同,因此难以同时检测人员数量和他们的位置。 Murakita等人[13]提出了一种基于马尔可夫链蒙特卡罗方法的方法来跟踪多个人,解决了楼层传感器的这种内在联系问题。在这个系统中,我们实施这种方法并使用地板传感器跟踪几个人。

3)全向摄像头:

a)主要目的:我们在智能机器人的前部空间周围安装了8个全向摄像头,以便识别除了人体跟踪之外的人的手势。

b)硬件:我们采用了VS-C42N-TR(Vstone Co. Ltd.)全向摄像头。成像范围从所有方位角的水平面向上约15度,并且距所有方位角的水平面向下约60度。其中八台摄像机安装在离地面1.5米的高度。

c)数据处理:提出了一种人体跟踪和姿态识别方法,该方法使用全向摄像机的三角测量和全向外观模型[14] [15]。但是,当图像中存在运动物体时,系统可能无法确定图像中的识别区域,因为该方法使用减法图像来检测人的位置并确定图像的识别区域。因此,我们调整此系统的楼层传感器信息。根据从楼层传感器获得的人的位置的信息来估计图像的人体区域,并且执行手势识别。在这个系统中,可以识别包括“鞠躬”和“指示方向”的手势结果。

4)话筒:

a)主要目的:为了识别人的声音,八个全向麦克风与全向摄像头安装在相同的地方。

b)硬件:所有麦克风都并行连接到一台计算机,并且计算机提取语音识别程序的语音数据。

c)数据处理:对于语音识别,需要尽可能少的噪音的语音信号。为此,系统必须根据从地面传感器获得的人体位置信息,选择最接近人的麦克风作为声源。接下来,必须从所选麦克风获得的信号中滤除背景噪音。将现有的语音识别方法(MicroSoft-SpeechSDK)应用于如此获得的语音信号。识别语法可以根据情况而改变。

图3 完善系统的网络系统构架

5)云台摄像机:

a)主要目的:系统必须知道人脸位置和方向,以便了解智能机器人通话的方向。

b)硬件:我们使用EVI-D100(索尼有限公司)云台摄像机。两台云台摄像机通过串行连接与电脑连接,电脑可以控制摄像机的摇摄,倾斜和变焦功能。

c)数据处理:我们基于边缘图像的直方图实现了人脸检测功能,并提取了肤色图像(例如,[16])。相机由平移,倾斜和缩放功能控制,以将检测到的人脸区域保持在中心并保持相同尺寸的图像。因此,从平移,倾斜和缩放功能的位置可知三维空间中的脸部位置。脸部方向可以从三个识别候选(前,左,右)中选择。

6)皮肤传感器:

a)主要目的:皮肤传感器检测人类的接触。总共有42个皮肤传感器安装在膝盖上方的皮肤下方。

b)硬件:皮肤传感器由PVDF薄膜制成。

c)数据处理:由于传感器输出与转换速度成比例的值,因此可以通过输出值的时间积分获得与接触力等效的值

B.软件架构

识别流程和行为的确定如图4所示。八台计算机(Pentium IV 3GHz)用于传感器数据处理和运动控制。传感器数据处理主要由五部分组成:手势识别,人体跟踪,语音识别,人脸检测和接触检测。将一次识别的结果应用于另一次识别有助于提高识别准确性。传感器处理部分的每个部分输出以下信息。

bull;手势识别:每个人的手势和人的身份证。

bull;人的位置跟踪:每个人的位置和人的身份证

bull;语音识别:识别的单词序列。

bull;人脸检测:三维空间和人脸方向上的人脸位置。

bull;接触检测:触及身体部位和外力的强度。

机器人的运动由模块单元收集每个自由度和语音数据的时间序列命令值。在本文中,我们称运动“模块”的包和分支条件处理“事件”。在一个事件中,首先执行动作,然后根据传感器处理的结果选择下一个动作。另外我们制作一个描述事件过程步骤的脚本。我们称之为“场景”。事件包括执行模块,传感器数据处理以识别模块执行之后的情况以及由该识别结果选择的以下事件ID。

图4 完善系统的软件架构

当在智能机器人控制计算机中指出场景时,顺序执行控制程序。程序如下所述。

1)获取事件的信息。

2)执行所描述的动作并播放语音文件。

3)从所指的传感器处理中获得识别结果。如果指向语音识别,则将语法ID传送到语音识别模块。根据识别结果,ID的ID将根据分支条件决定。

4)回到(1)。

该事件限制了识别的候选人和适当的识别传感器。这增加了每个传感器数据处理部分的识别准确度。

对于未受过培训的程序员,该方案以XML描述。

自然当机的产生与评价

ReplieeQ2 智能机器人在短期和受限的交互中实现了类似人类的存在[6],[7]。在本节中,为了证明系统的有效性,进行了实验。实验表明,传感器网络的信息改善了人类的性质。现有研究[7]评估了没有感官信息的机器人类人性,但感觉信息可以提高其类人性。因此,我们准备了主题接近闲置智能机器人的情况,并评估了智能机器人在这种情况下的行为印象。比较了两种人类存在的印象。一种是机器人的反应是基于感觉信息产生的印象,另一种是没有感觉信息的空闲运动的印象,即与现有研究[7]相同。怠速运动是一种运动,机器人根据周围环境静静地坐着,凝视或盯着某物。

A.产生空转行为的基本概念

怠速行为不包含我们强烈期望的反应行为,与智能机器人中与人交互的情境中的行为形成对比。然而,以随机方式完全选择的行为无法给智能机器人带来人性化的本质。为了让主体感受来自智能机器人的人性化特征,有必要设计出让主体容易相信智能机器人具有意图或心理状态的智能机器人行为。为此,现有的研究表明,有必要为机器人构建精神状态。例如,Miwa等人[17]构建了一个整合有意识模型的心理模型。该模型允许机器人在几个刺激之间不是随机地清楚地选择刺激(传感器输入)。从几个刺激中选择刺激的原因可以使机器人显示出更像人类的反应。 Breazeal等[18]提到机器人的情绪表达使得与人类的交互更加复杂和丰富。

在这项研究中,我们观察一个安静地坐在现实中的人,并构建一个心理模型来呈现周围环境与精神状态之间的关系。精神状态是一种情绪状态,包括恐惧和恐惧。制作了一个处于中立精神状态的机器人的基本运动模块。例如,跟在另一个人眼前的动作和一个俯视的动作。一些基本的运动模块被制作出来,这些模块被随机执行,而中性精神状态仍在继续。接下来,为每个精神状态构建子场景。当智能机器人的精神状态改变时,子情节被执行,对应于心理状态,然后智能机器人显示对传感器输入的反应。

根据对安静坐着的人的观察以及他们的报告,制作了基本动作模块,心理状态模型和子情景动作模块。

图5 A模式的行为示例

图6模式A各个位置的ID

B.观察安静地坐着的人类

在由窗帘或墙壁围起来的地方进行观察。我们拍摄了一个安静坐着的人的动作和一个人在他/她周围的区域由摄像机的动作的视频。实验者指示受试者坐在椅子上并保持坐姿20分钟。这是受试者B.实验者指示另一受试者在2.0米times;2.0米范围内观察受试者B时自由行动20分钟。这是受试者A.在观察之后,受试者B给予他们对受试者A的印象以构建精神状态模型。在他们记得的20分钟内,受试者给予了尽可能多的印象。

C.基本运动模块的构造

对象A的行为如图5所示。作为该观察的结果,获得了来自下面所示的两个对象的六个共同运动。这些运动被定义为智能机器人的基本运动模块,因为它们经常在安静的坐着的人体中看到。

bull;朝着主题A看起来的方向看。

bull;只用眼球运动和尽可能少的身体运动来看待主体A.

bull;看几次主题A.

bull;朝前看,以免看到主题A.

bull;往下看地面。

bull;继续观察主题A(跟随主题A)。

D.精神状态模型的构建

对象B的印象的答案表明印象取决于对象A的位置。另外,实验者相应地口头询问对象B的印象,并且实验者在幕后。因此,我们根据受试者A的行为和位置对心理状态进行分类。根据受试者A的所有动机来映射该分类,但根据实验者的观察和以下原因进行映射。表I表示这些类。这是心理状态模型。对象A的位置被分类在图6中。表I的第一列表示

全文共13529字,剩余内容已隐藏,支付完成后下载完整资料

资料编号:[15767],资料为PDF文档或Word文档,PDF文档可免费转换为Word