英语原文共 8 页,剩余内容已隐藏,支付完成后下载完整资料

通过概率规划归纳的人类级别的概念学习

Brenden M. Lake, Ruslan Salakhutdinov, Joshua B. Tenenbaum

摘要

人类学习新概念往往能从单个简单样例成功的实现推广,但机器学习算法通常需要几十或几百个样例来执行类似的准确性。相较于常规算法,人们也可以以更丰富的方式使用所学的概念来展开行动,想象和解释。我们提出了一个计算模型捕捉到这些人对于一大类简单的视觉概念(如世界的字母手写体)的学习能力。该模型将概念表示成简单的程序根据贝叶斯准则最好的解释观测到的样例。在一个具有挑战性的一次性分类任务中,该模型完成了人类级别的表现,而且比近年来的深度学习方法效果更好。我们还提出了几个“视觉图灵测试”来测试该模型的创新泛化能力,在许多情况下,是很难与人类行为区分开的。

介绍

尽管人工智能和机器学习已经取得了巨大的进步,但是机器系统还是无法掌握人类概念学习的两个主要方面。首先,世界上存在无数自然和人造的事物,但人们都可以从一个或者几个样例中就学习到新的概念,但标准的机器学习算法却需要几十个甚至几百个类似的样例才可以达到这样的准确度。例如,人们要理解一种新颖的两轮车,只需要看1张图(图A1)就好了,就算是一个孩子也可以通过图A1-A3来理解这个新事物的概念。相反的,许多领先的机器学习都要通过海量的数据模型才可以理解概念,特别是取得新层次的以语音识别为基准的深度学习模型(4-9)。其次,人们比机器学到更丰富的表达,即使对象只是一个简单的概念(图1B),除了理解,人们还可以做到更多,例如举一反三(图1 ii)(10),剖析对象整体和局部的关系(图1 iii),以及在现有类别的基础上再做分类(图1 iv)。相比之下,就算是最好的分类机器也难以做到这些,通常是需要专门的算法才可以一一尝试。 我们面临的最主要的挑战就是解释人类这两方面的学习方法:人们是怎样通过一两个样例就可以学习新概念的?人们是如何进行这样抽象、丰富、灵活的再加工的?当这两个问题叠加,又出现了新的挑战:如何基于如此简单的数据而产生丰富的加工成果?对于任何学习理论(4,14-16)来说,越复杂的模型需要越多的数据,才可以达到良好的泛化,在新陈之间可以通用。但人类就是可以做到这一点,人脑中似乎有某种“导航”,帮助人类把简单的数据加工成复杂的成果。

这篇文章旨在介绍贝叶斯学习程序(BPL)框架,如何依靠单个样例来对一大类视觉概念进行学习然后进行无异于人类的加工。概念被表示为简单的概率归纳,是一种概率生成模型,即抽象描述语言的结构化程序(17,18)。我们的框架汇集了三个关键信息:组合性,因果关系,学会学习,这在过去几十年都分别对认知科学和机器学习产生了很大影响(19-22)。通过该程序,丰富的概念可以从简单的原语“组合”而来。它们的概率语义来处理噪声并支持创造性的归纳,(不像其他的概率模型)可以自然捕捉的真实过程中产生一个类样例的抽象的“因果”结构。构建程序能利用贝叶斯原则最好的解释观测样例,模型“学会学习”(23,24)通过开发多层先验模型可以允许与相关概念的经验来缓解新概念学习(25,26)。这些先验代表学习归纳偏置(27),提取关键的规律和变量维数,该维数是给定域的概念类型和各个概念的示例(或符号)的变量维数。简而言之,BPL可以通过现有的碎片信息来构造新的程序,捕捉真实世界中的因果关系,组合属性,重生成多层面的结果。

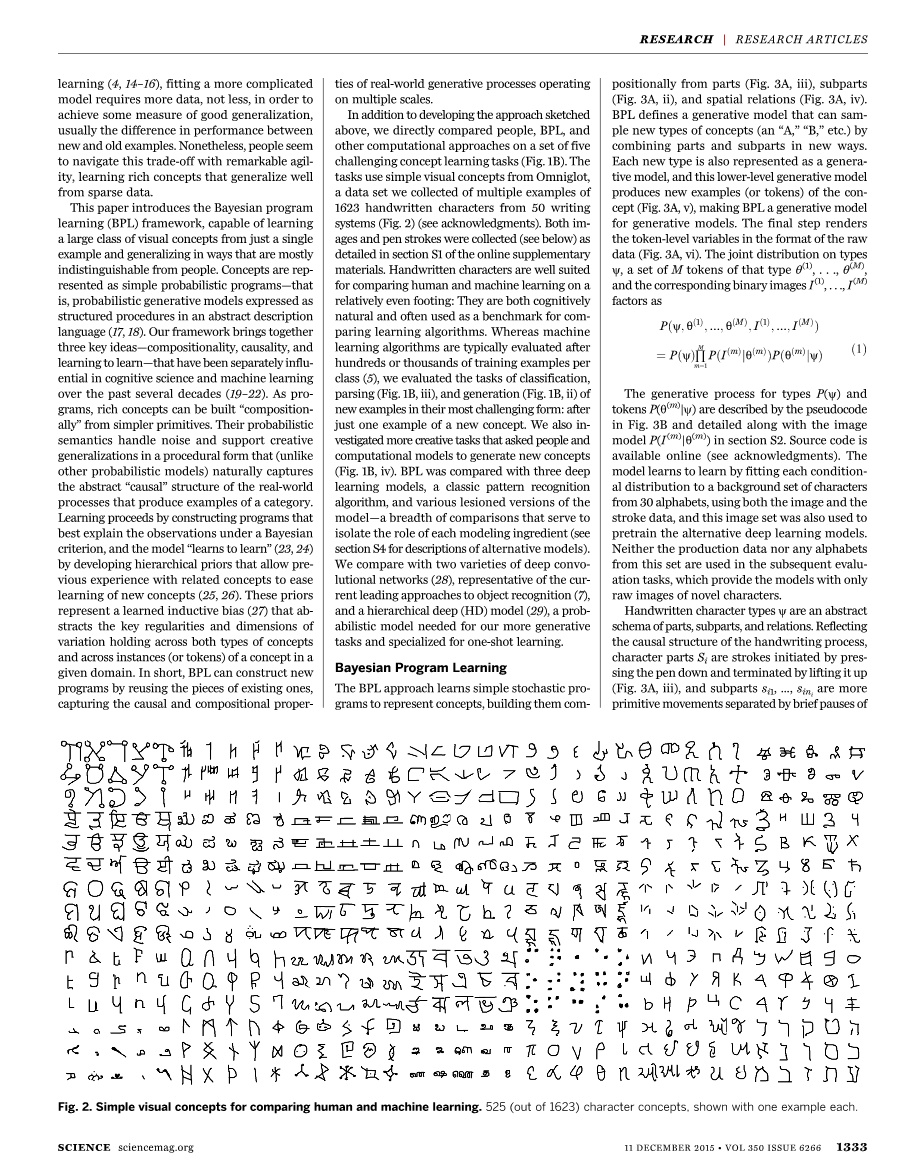

除了开展上面提到方法,我们直接比较人,BPL以及其他的计算方法在5个挑战性的概念学习任务中的表现(图1 B)。这些任务使用的是从Omniglot中抽取的简单视觉概念,都是我们从50个书写系统中收集的1623个手写字符(图2)。图像和笔画均被收集(如下),在网上的支撑材料的第1部分会有详细的资料。手写字符非常合适用来比较人类和机器学习的差异:他们都是认知自然并且经常被用来作为比较学习算法的基准。而机器学习算法通常从数百或数千个每种类的训练样本中评估(5),我们评估的是以它们最具挑战性的形式下的分类,分解(图1b,III),生成(图1b,II)任务:仅从一个概念样例。我们还通过更有创造性的项目来区别人类和计算机分别生成的概念(图1B ii)。采用三种不同的深度学习模型来做比较,一个经典的模式识别算法,和各种损伤的版本比较——为了分离不同模型成分的作用幅度(见第4部分的其他模型的介绍)。包括两种目前主流的目标识别(7)的深卷积网络模型(28),和一种需要我们更多的生成任务和专门的一次学习的概率模型——分层的深度(HD)模型(29)。

贝叶斯学习程序

BPL从简单的随机程序中学习到的概念,从部分和子部分组合而来。BPL定义了一个生成模型,以新的方式将部分和子部分结合生成概念的新类型(“A”,”B”等)。每一个新的类型又作为一个生成模型,这种低级的生成模型产生新的概念的样例(或符号)(图3A V),作为下次加工的基础进行再次加工。最后一步是用原始数据(图3A,VI)的样式渲染符号级别的变量。类型Psi;和该类型对应的M个符号,hellip; ,和相应的二进制图像,hellip;,的联合分布为:

类型P(Psi;)和符号P(|Psi;)的生成过程的伪代码在图3B中,并且在第2部会有附有图像模型P(|)的详细数据,也可以在线找到源代码。学会学习模型拟合每个条件分布到30个字符表的字符背景集中,包括图像和笔画数据。这个图片集也用来提前训练其他的深度学习模型。产生的数据和这个集合里任何字母表都不会用在随后的评估任务中,评估任务中提供给模型的都是新的字符的原始图像。

手写字符类型Psi;是一个抽象的模式,这个模式包括部分,子部分以及部分和整体的关系。反映书写结构因果关系的字符部分Si是从笔落到笔起的笔画(图3A,iii),子部分Si1,Si2,hellip;,Sin是更原始的动作,是由笔的简短的暂停分离(图3A,ii)。建立一个新的字符类别,第一,该模型从背景集中测得的经验分布取样得到部分的数量k 和对于每个部分i=1,hellip;,k 的子部分数量 。第二,从背景集中获得的离散的原始数据取样建立部分 的模版(图3A,i),因此下一步动作的概率则取决于前步。第三、通过取样得到控制点和每个子部分的规模参数,部分是参数化曲线(样条)的基础。最后、按照整体部分的关系的定义(图3A,iv),将部分大致的放置在开始或结束的独立位置或者连接着之前部分的位置。

字符符号是通过字体的每个部分及其之间的关系和墨水如何从笔挥洒到纸上生成。首先,为子部分的规模和控制点加上信号噪声,形成字符级别的笔画轨迹.其次,笔画轨迹的精确的起始位置 是从与先前笔画的关系的示意图取样而来。第三,取样全局变形,包括仿射变形,以及其他便于概率推理的适应性噪声参数(30)。最后,二进位制图像是由一个随机的渲染功能,通过灰度油墨把笔画轨迹连接起来,并且将像素值转换成独立的伯努利概率。

后验推理需要搜索程序中的大量组合才能来生成一个原始图片。我们的策略是使用快速的自下而上的方法(31)生成一系列候选解析。最好的候选者则通过连续优化和局部搜索的方式细化,产生一个离散逼近到后验分布P(Psi;, |)(第3部分)。图表4A 展示了一系列训练图像的发现程序和它们是怎样再次拟合到不同的测试图像去计算分类分数 log(P())(后验概率的指数)。更高的分数表明他们更可能属于同一类。一个高分的出现是当至少一个部分集合和关系在不违背学到的类内变异模型的软约束下,可以合理解释训练和测试图像。图表4B比较了对于一些字符的模型得分高的解析和实际的人类解析结果。

结果

人、BPL、其他模型被并列的放在5个概念学习的任务(任务举例 图5)中进行比较,检测从一个或几个样例泛化的不同形式。所有的行为实验都在亚马逊的Mechanical Turk进行的,实验过程与细节在第5部分展示。实验主要结果由图表六呈现,病态分析和控制等在第6部分中报告。

一次性分类是由10个字母表的字母表内的分类任务进行评估。如图1B,i所示,新类型的一个图像显示,参与者要求从20个不同的字符中选出该新类型的样例,这20个字符是由该字母表的绘画人员产生的。性能表现参见图6A,错误率达95%。作为一个基准,改进后的Hausdorff距离(32)在中心图像中计算,错误率减少至38.8%。人类是熟练的一次性学习者,平均错误率仅为4.5%。BPL表现出了类似的3.3%的错误率,实现比深度卷积网络(ConvNet;13.5%的错误率)和和HD模型(34.8%)更好的性能,每个模型都是在一系列的计算机视觉任务中表现很好的深度学习模型的适应性版本。一个为这次一次性学习任务优化的深度深暹罗卷积网络实现了8%的错误率(33),但依然是人类以及我们这个模型犯错率的两倍。BPL的优势点在于能够模仿学习概念中潜在的因果过程,是不同于此处检验的专门的深度学习的策略。BPL在其他方面也做出了积极贡献,即显示了没有“学会学习”(此处指符号层面)或“组合”时,会呈现较高的错误率(分别为为11.0%和14.%)。学会学习是指通过破坏生成模型的超参数单独研究类型与规则层面的内容。组合是指将BPL比作仅仅一个基于样条笔画的匹配模型,就像早期像早期手写字符的分析合成模型那样,有类似的限制(34,35)。

人类一次性学习的能力不仅仅是分类,它还包括一系列其他技能,如针对新的概念举出样例。我们通过图灵视觉测试,比较了人和机器的创意输出,裁判尝试从给出的配对的机器和人的样例中的识别出哪个是机器。在我们最基本的任务中,九个人被要求分别生成一个给定样例概念的新的示例,裁判需要比较九个人画的字符和九个由BPL画的字符。我们基于裁判的准确性来评估模型,我们把裁判的准确性称之为识别(ID)水平,理想的模型表现为50%的ID水平,表明他们无法区分模型的行为和人类的行为,最坏情况下的表现是100%。每个裁判(N=147)完成了49次封闭反馈的实验,并单独对他们进行了分析和最后的整合。结果在图6B中显示(新的模板)。裁判识别人类与BPL仅有52%平均ID水平。作为一个小组,他们的表现几乎没有比“猜”([t(47) = 2.03, P

= 0.048])的好,而且48个裁判中仅有3个人的ID水平明确的高于“猜”。不同小组的裁判对三种损伤模型在不同条件的视觉图灵测试中进行评判,以此验证BPL中模型关键要素的必要性。学会学习(仅符号水平)和组合这两个损伤版本显著降低了图灵测试任务(80%的ID水平,19个里有17个裁判高于“猜”,另外26个中有14个ID水平达到65%),表明能通过这个任务是不平凡的,也表明这两个因素都是有助于提高BPL的人类级别生成水平的。为了更直接的评判解析(图4B),我们与不同裁判(N=143)一起测试了这一任务的动态版本,每一项试验都显示人与BPL绘制相同的字母时都有相应的行动。BPL在这个视觉图灵测试任务中的表现并不完美(平均59%的ID水平;新的模板(动态)见图6B)。但是,随机学习笔画顺序和方向这些先验知识显著提高ID的水平(71%),表明对BPL动态捕捉正确的因果关系是很重要的。虽然从30个背景字母中学到新的字符被证明是有效的,但许多人类学习者只需要更少的经验,在相关的绘制任务中只需熟悉1个或几个字母表。为了看看在更局限的经验下模型的表现如何,我们用两个只含几个背景字母表的子集合再次训练了其中数个模型。在一次性分类中BPL取得了与此前相似的成绩(两个子集错误率分别为4.3%和4.0%)。深度卷积网络的表现则显著变差(错误率分别为22.3% 和24.0%)。在模板生成(N=59)的图灵测试任务中,第一组BPL的表现也差不多(52%平均ID水平,这和“猜”t(26)=1.04,Pgt;0.05没有显著差别),27个中的仅3人高于“猜”;第二组的表现稍微差点(57%的平均ID水平;t(31)=4.35,Plt;0.001,32个中7个人水平高于猜)。这个结果表明尽管学会学习对BPL的成功很重要,但是这一模型的结构允许它充分发挥相当有限的训练背景数据的作用。

人类的生产能力远远不只生成给定概念的新样例:人类可以生成全新的概念。为了测试这一点,我们给参与者展示了几个外文字母表,要求他们迅速创造一些看起来与属于同一张字母表的新字母(图.7A)。通过在类型层面设定一个非参数先验,BPL可以捕捉这一行为,重新利用示例字母中的笔画从而形成风格一致的新字母(见第7部分)。在一场视觉图灵测试中人类裁判比较了人和BPL的成果(N = 117),图7A i和iii有一系列的展示。裁判只有平均49%的ID水平(图6B(从行的类型)),这和“猜”t(34)=1.04,Pgt;0.05 没有明显差异。35个人中分别只有8个人的水平显著高于“猜”。相反,一个损伤学会学习模型(类型水平)是通过对视觉图灵测试单独的条件测试,其中69%的实验被才 被成功地检测,比起BPL,检测明显容易得多(25个中有8个水平高于“猜”)。第6部分中进一步的比较表明,这一模型生成合理的新奇字母而本身非风格的一致,是其通过测试的关键。我们还发现个别裁判对BPL和人的比较差异较大,正如他们的ID水平所反映的那样,35个裁判中有10个人ID水平显著低于“猜”;相反,只有两个参与者有机会低于“猜”的ID水平,BPL在所有其他的实验如图6B所示。

最后,裁判们 (N = 124)还比较了在不受给定字母的约束下,人和模型如何完全自由地生成新奇字母(Fig. 7B)。对BPL中字母类型P(Psi;)的先验分布的抽样导致了视觉图灵测试中ID层面的平均ID水平达57%(32中11人水平高于“猜”)。重新利用示例字母中的笔画设定的非参数先验,BPL实现了51%的ID水平(图7B和新概念(无约束)图6b;ID的水平与“猜”没有显差异,t(24)= 0.497,P>0.05;25个中有2人水平高于“猜”)。一个损伤版本表明组合(68%,22个中5人)和学会学习(64%,45个中22人)在通过这项测试中都至关重

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[154074],资料为PDF文档或Word文档,PDF文档可免费转换为Word