英语原文共 9 页,剩余内容已隐藏,支付完成后下载完整资料

基于图像的表识别:数据、模型和评价

摘要-与文档中特定主题相关的重要信息通常以表格形式组织,以帮助读者进行信息检索和比较,这可能很难用自然语言提供。然而,非结构化数字文档中的表格数据,如可移植文档格式(PDF)和图像,由于其结构和样式的复杂性和多样性,很难解析为结构化的机器可读格式。为了便于基于图像的表识别和深入学习,我们开发了最大的公共表识别数据集PubTabNet[1],其中包含56.8万个具有相应结构化HTML表示的表图像。PubTabNet是通过匹配PubMed Centraltrade;科学文章的XML和PDF表示而自动生成的中央开放存取子集(PMCOA)。我们还提出了一种新的基于注意的编码器-双解码器(EDD)结构,将表的图像转换成HTML代码。该模型具有一个结构解码器,它可以重建表结构并帮助单元解码器识别单元内容。此外,我们还提出了一种新的基于树编辑距离的相似度(TEDS)度量来进行表识别。实验表明,EDD模型仅依靠图像表示就可以准确地识别出复杂的表格,其绝对TEDS分数比现有模型高9.7%。

1 导言

表格格式的信息在各种文件中都很普遍。与自然语言相比,表提供了一种以更紧凑和结构化的格式汇总大量数据的方法。表还提供了一种格式,以帮助读者查找和比较信息。生物医学领域中表格信息相关性的一个例子是在基因数据库的管理中,与表格格式的表格或文件中的信息相比,在文章的叙述部分中只有2%到8%的信息可用[1]。

文档中的表通常是为人类理解而格式化的,人类通常擅长分析表结构、标识表头和解释表单元之间的关系。然而,由于表格数据的布局和样式具有很大的变化性,因此机器很难理解非结构化格式的表格数据(如PDF、图像)。表理解的关键步骤是以机器可读的格式表示非结构化表,其中表的结构和每个单元格中的内容根据预定义的标准进行编码。这通常被称为表识别[2]。

本文解决了基于图像的表格识别中的以下三个问题,即表格的结构化表示仅由图像输入重建:

a) 数据:我们提供了一个大型数据集PubTabNet,它包含了从PMCOA中包含的科学文章(PDF格式)中提取的56.8万多个异构表的图像。通过将PDFs的元数据与相关的结构化表示(由PMCOA[2]以XML格式提供)匹配,我们自动用表的结构和每个单元格中的文本(以HTML格式)的信息注释每个表图像。

b) 型号:我们开发了一种新的基于注意力的编码-解码(EDD)架构(见图1),它由一个编码器、一个结构解码器和一个单元解码器组成。编码器捕捉输入表图像的视觉特征。结构解码器重建表结构,帮助单元解码器识别单元内容。我们的EDD模型是在PubTabNet上训练的,与现有的表识别方法相比,具有更好的性能。误差分析表明,现有的EDD模型有可能得到改进,从而提高性能。

c) 评价:通过将表建模为树结构,提出了一种新的基于树编辑距离的图像表识别评价指标。此度量优于文献和竞赛中常用的度量[3],它完全忽略了空单元格、全局表结构信息和单元格内容识别的细粒度性能。

2 相关工作

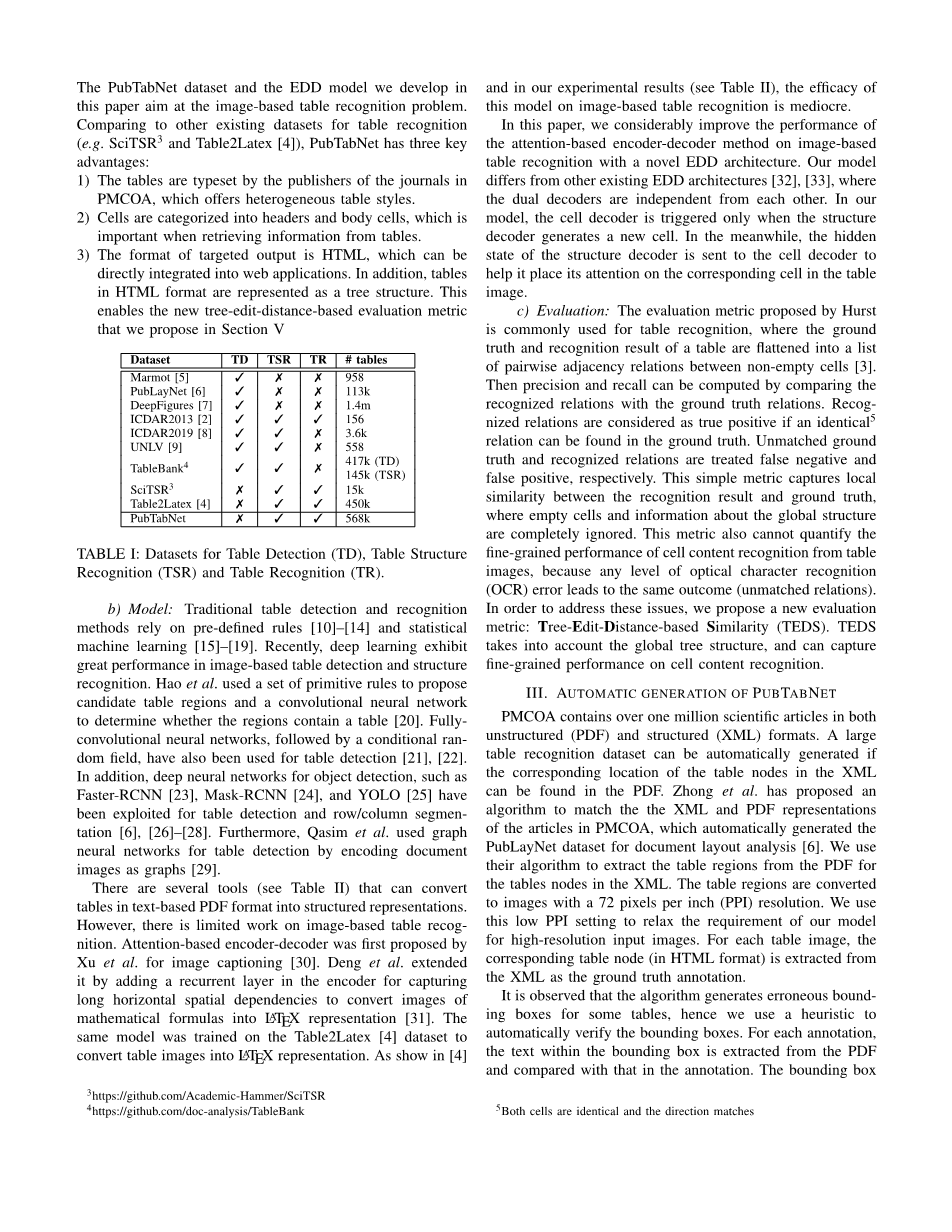

a) 数据:分析非结构化文档中的表格数据主要集中在三个方面:一、表格检测:定位文档中表格的边界框;二、表格结构识别:只分析表格的结构(行和列布局)信息,表识别:分析表单元的结构信息和内容。表1比较了为解决这三个问题中的一个或多个问题而开发的数据集。

本文针对基于图像的表格识别问题,开发了PubTabNet数据集和EDD模型。与用于表识别的其他现有数据集(如SciTSR3和Table2Latex[4])相比,PubTabNet有三个主要优势:

1) 这些表格是由PMCOA中的期刊出版商排版的,它提供不同的表格样式。

2) 单元格分为头单元格和正文单元格,这在从表中检索信息时非常重要。

3) 目标输出的格式是HTML,可以直接集成到web应用程序中。此外,HTML格式的表表示为树结构。这使得我们在第五节中提出的新的基于树编辑距离的评估度量成为可能

|

数据集 |

TD |

TSR |

TR |

#表格 |

|

Marmot[5] |

958 |

|||

|

PubLayNet[6] |

113k |

|||

|

DeepFigures[7] |

1.4m |

|||

|

ICDAR2013[2] |

156 |

|||

|

ICDAR2019[8] |

3.6k |

|||

|

UNLV[9] |

558 |

|||

|

Table Bank4 |

417k(TD) 145k(TSR) |

|||

|

SciTSR[3] |

15K |

|||

|

Table2Latex[4] |

450K |

|||

|

PubTabNet |

568K |

表1 表格检测(TD)、表格结构识别(TSR)和表格识别(TR)的数据集。

b)型号:传统的表格检测和识别方法依赖于预定义的规则[10]-[14]和统计机器学习[15]-[19]。近年来,深度学习在基于图像的表格检测和结构识别中表现出了良好的性能。Hao等人。使用一组原始规则来提出候选表区域,并使用卷积神经网络来确定这些区域是否包含表[20]。Fullyconvolutional神经网络,后跟一个条件随机场,也被用于表检测[21],[22]。此外,用于对象检测的深层神经网络,如更快的RCNN[23]、掩码RCNN[24]和YOLO[25]已被用于表检测和行/列分割[6]、[26]–[28]。此外,Qasim等人。使用图神经网络通过将文档图像编码为图来进行表检测[29]。

有几种工具(见表二)可以将基于文本的PDF格式的表转换为结构化表示。然而,基于图像的表格识别的研究还很有限。基于注意的编码解码器是由Xu等人首次提出的。用于图像字幕[30]。邓等人。通过在编码器中添加一个递归层来扩展它,以捕获长的水平空间相关性,从而将数学公式的图像转换为乳胶表示[31]。在Table2Latex[4]数据集上训练相同的模型,以将表图像转换为乳胶表示。如[4]和我们的实验结果(见表二)所示,该模型在基于图像的表格识别方面的效果一般。

本文采用一种新的EDD结构,大大提高了基于注意的编解码方法在基于图像的表识别中的性能。我们的模型不同于其他现有的EDD架构[32],[33],其中双解码器彼此独立。在我们的模型中,只有当结构解码器生成一个新的单元时,才会触发单元解码器。同时,结构解码器的隐藏状态被发送到单元解码器,以帮助其将注意力放在表图像中相应的单元上。

c)评价:Hurst提出的评价指标通常用于表识别,将表的基真值和识别结果平展成非空单元格之间的成对邻接关系列表[3]。然后,通过比较识别关系和基本真值关系,计算出准确度和召回率。如果在基本真理中可以找到相同的关系,则公认的关系被认为是真正关系。不匹配的基本真理和公认的关系分别被视为假阴性和假阳性。这个简单的度量捕获了识别结果和地面真实性之间的局部相似性,其中空单元格和关于全局结构的信息被完全忽略。这种度量也不能量化表图像中细胞内容识别的细粒度性能,因为任何级别的光学字符识别(OCR)错误都会导致相同的结果(不匹配的关系)。为了解决这些问题,我们提出了一种新的评价指标:基于树编辑距离的相似度(TEDS)。TEDS考虑了全局树结构,能够捕捉到细胞内容识别的细粒度性能。

3 PUBTABNET的自动生成

PMCOA包含超过一百万篇非结构化(PDF)和结构化(XML)格式的科学文章。如果可以在PDF中找到XML中表节点的相应位置,则可以自动生成大型表识别数据集。Zhong等人。提出了一种匹配PMCOA中文章的XML和PDF表示的算法,自动生成PubLayNet数据集进行文档布局分析[6]。我们使用他们的算法从PDF中提取XML中表节点的表区域。表格区域转换为分辨率为72像素每英寸(PPI)的图像。我们使用这种低PPI设置来放宽模型对高分辨率输入图像的要求。对于每个表图像,从XML中提取相应的表节点(HTML格式)作为基本真值注释。

观察到该算法对某些表产生了错误的边界框,因此我们使用启发式算法来自动验证边界框。对于每个批注,边界框中的文本将从PDF中提取并与批注中的文本进行比较。如果两个文本的术语频率逆文档频率(Tf-idf)特征的余弦相似性大于90%,且两个文本的长度差异小于10%,则认为边界框是正确的。此外,为了提高数据的可学习性,我们删除了包含任何跨10行或10列的单元格的稀有表,或所有表中出现次数少于50次的字符。注释包含数学和内联公式节点的表也将被删除,因为我们发现它们没有一致的XML表示。

过滤表样本后,我们整理表的HTML代码,以消除不必要的变化。首先,我们从表图像中删除不可重构的节点和属性,如超链接和首字母缩略词的定义。其次,在某些表中,表头单元格被定义为th节点,而在其他表中则被定义为td节点。我们将标题单元格的定义统一为td节点,这将保留单元格的标题标识,因为它们仍然是thead节点的后代。第三,除了td节点中的“rowspan”和“colspan”之外的所有属性都被剥离,因为它们控制web浏览器中与表图像不匹配的表的外观。这些管理将导致一致和干净的HTML代码,并使数据更易于学习。

最后,将样本随机分成60%/20%/20%的训练/开发/测试分区。训练集包含548592个样本。由于只有一小部分表包含跨越(多列或多行)单元格,因此对原始开发集和测试集的评估将强烈偏向于没有跨越单元格的表。为了更好地评估模型在复杂表结构上的性能,我们创建了更均衡的开发和测试集,随机绘制了5000个包含跨单元格的表和5000个不包含跨单元格的表,这些表格来自相应的原始集。

4 编码器-双解码器(EDD)模型

|

图1 EDD架构。编码器是一种卷积神经网络,它能捕捉输入表格图像的视觉特征。分别为结构解码器和单元解码器。和分别是结构解码器和单元解码器的递归单元。结构解码器重建表结构,帮助单元解码器生成单元内容。结构解码器和单元解码器的输出被合并以获得输入表图像的HTML表示。 |

图1显示了EDD模型的体系结构,它由一个编码器、一个基于注意的结构解码器和一个基于注意的单元解码器组成。使用两个解码器的灵感来自两个直观的考虑:i)表结构识别和单元格内容识别是两个截然不同的任务。使用一个基于注意力的解码器同时解决这两个任务是无效的。ii)结构识别任务中的信息有助于定位需要识别的单元。编码器是一种卷积神经网络(CNN),它捕捉输入表格图像的视觉特征。结构解码器和单元解码器是递归神经网络(RNN),其注意机制在[30]中提出。结构解码器只生成定义表结构的HTML标记。当结构解码器识别新的单元格时,触发该单元格解码器,并使用结构解码器的隐藏状态来计算识别新单元格内容的注意度。这确保了由结构解码器

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[237526],资料为PDF文档或Word文档,PDF文档可免费转换为Word