英语原文共 8 页,剩余内容已隐藏,支付完成后下载完整资料

Res2Net:一种新的多尺度骨干体系结构

Shang-Hua Gaolowast;, Ming-Ming Chenglowast;, Kai Zhao, Xin-Yu Zhang, Ming-Hsuan Yang, and Philip Torr

摘 要:在众多的视觉任务中,多个尺度上表示特征是非常重要的。主干网卷积神经网络 (CNN) 的最新发展不断显示出较强的多尺度表示能力,从而在广泛的应用中获得一致的性能收益。然而,大多数现有的方法都是以分层的方式表示多尺度特征。在本文中,我们提出了一种新的构建块,即 Res2Net,通过在一个单独的残差块内构造分层的类残差连接。Res2Net 在粒度级别上表示多尺度特征,并增加了每个网络层的感受野范围。提议的 Res2Net 块可以插入最先进的主干 CNN 模型,例如 ResNet、ResNeXt 和 DLA。我们在所有这些模型上评价了 Res2Net 模块,并证明了在广泛使用的数据集上(例如 CIFAR-100 和 ImageNet)相对于基线模型的一致性能增益。代表性计算机视觉任务的进一步消融研究和实验结果,即对象检测、类别激活映射和显著对象检测,进一步验证了 Res2Net 相对于最先进基线方法的优越性。源代码和经过培训的模型将公开提供。

关键词:多尺度,深度学习

1.引言

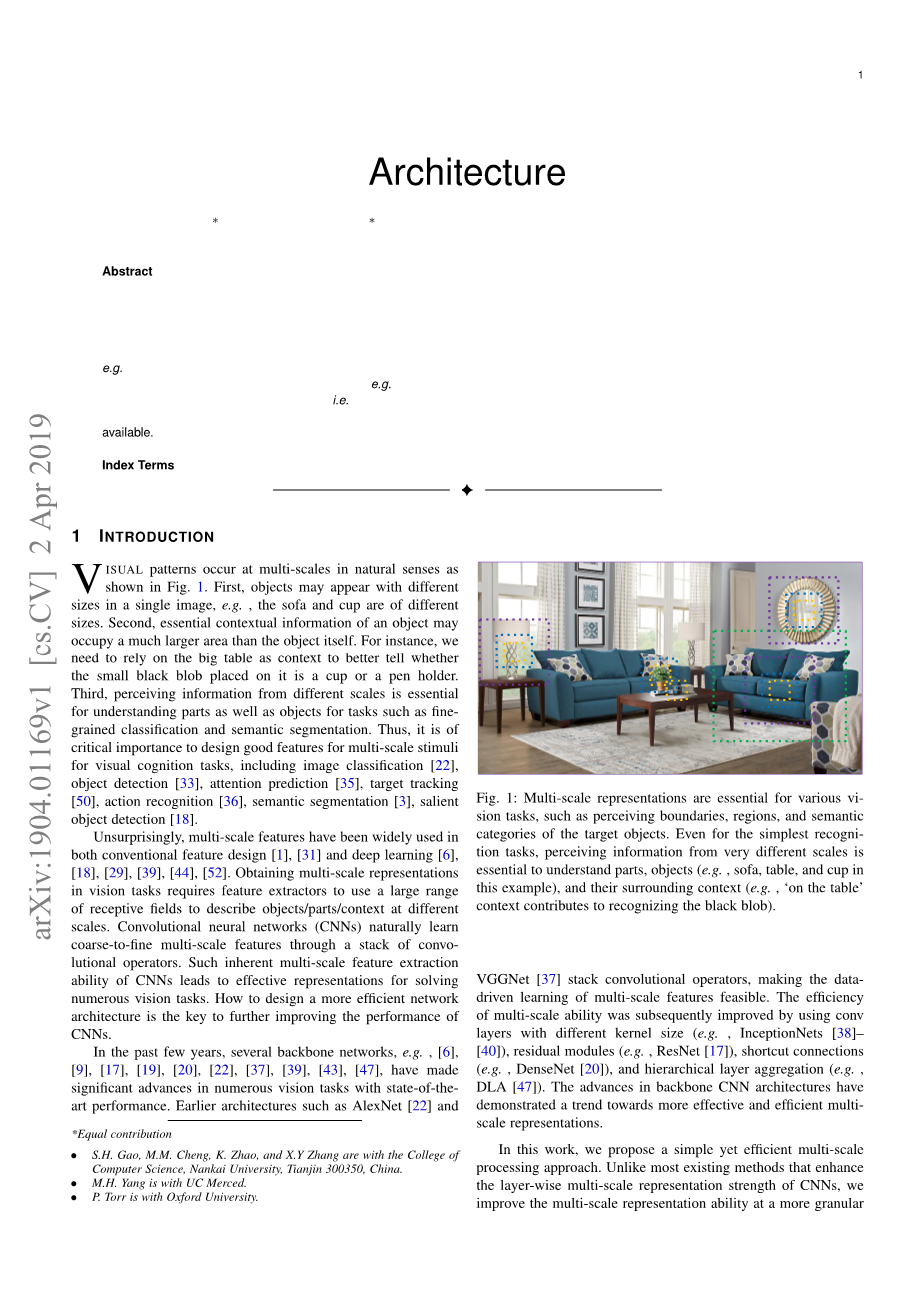

视觉模式出现在多尺度的自然感觉中,如图 1 所示。首先,在单个图像中可能出现大小不同的物体,如沙发和杯子大小不同。其次,对象的基本上下文信息可能比对象本身占据更大的面积。例如,我们需要依靠大桌子作为依据来更好地分辨放在上面的小黑点是杯子还是笔芯。第三,感知来自不同尺度的信息对于理解诸如细粒度分类和语义分割等任务的部分以及对象至关重要。因此,设计视觉认知任务的多尺度刺激的良好特征至关重要,包括图像分类 [22]、对象检测 [33]、注意预测 [35]、目标跟踪 [50]、动作识别[36]、语义分割 [3]、显著对象检测[18]。

不出所料,多尺度特征已经广泛应用于传统的功能设计 [1]、[31] 和深度学习[6]、 [8]、[29]、[39]、[44]、[52]。视觉任务的多尺度表征需要特征提取器利用较大范围的感受野来描述不同语境下的目标部件上下文。卷积神经网络 (CNN) 通过一组凸性算子自然地学习自上而下的多尺度特征。由于 CNN 固有的多尺度特征提取能力,为解决视觉任务提供了一种有效的表示方法。如何设计一个更高效的网络构架是进一步提高网络性能的关键。

在过去的几年里,一些骨干网络,例如[6]、[9]、[17]、[19]、[20]、[22]、[37]、[39]、[43]、[47],在许多具有最佳性能的远景任务中取得了引人注目的进展。早期的体系结构,如 AlexNet 22和VGGNet 37 堆栈卷积算子,使得多尺度特征的数据学习成为可能。随后通过使用不同内核大小的 conv 层(例如,InceptionNets 38 C 40)、剩余模块(例如,ResNet 17)、快捷方式连接(例如,DenseNet 20)和分层层聚合(例如,DLA 47),提高了多尺度能力的效率。主干网 CNN 体系结构的进步显示出更有效和高效的多尺度表示的趋势。

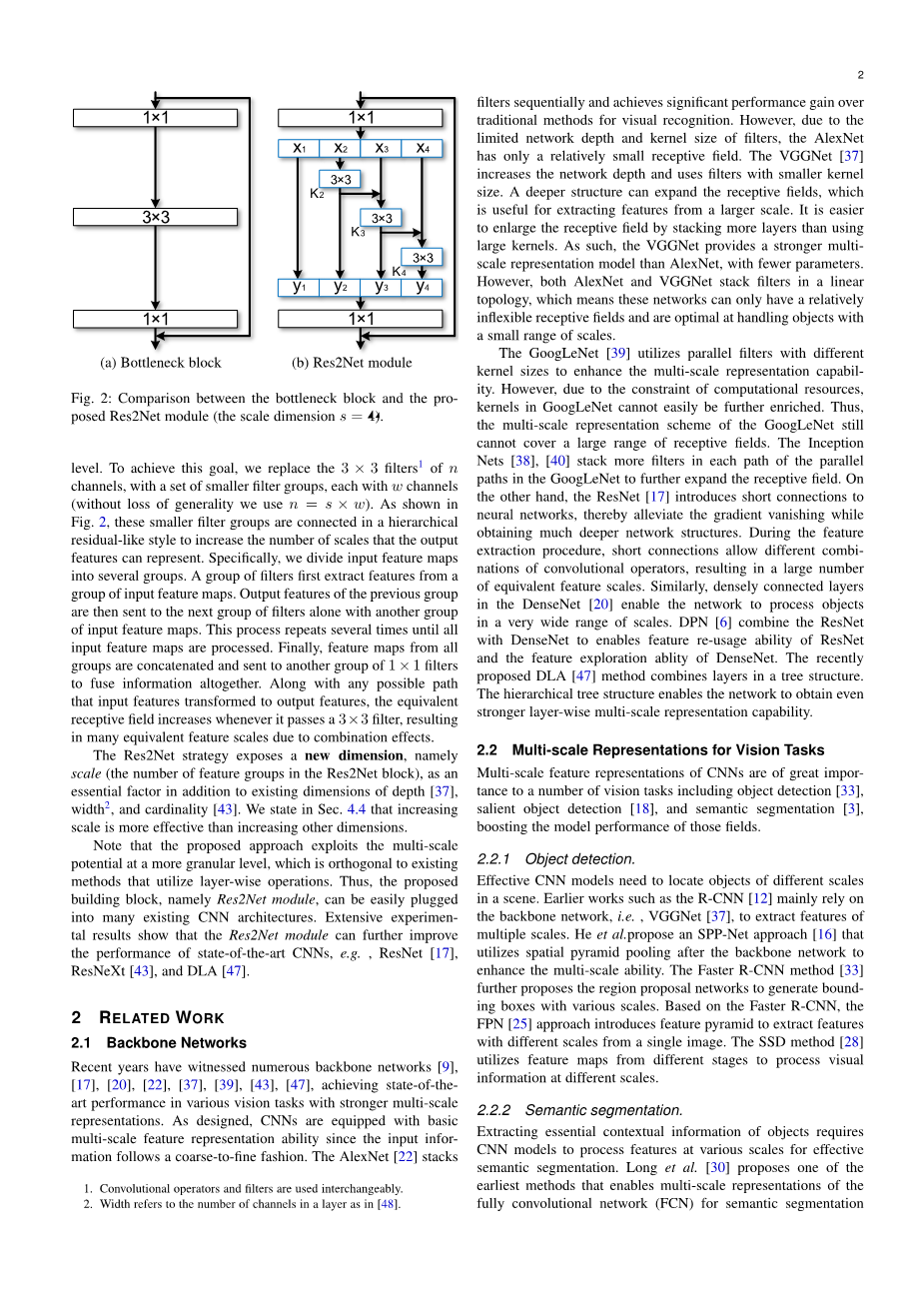

在这项工作中,我们提出了一个简单而有效的多尺度处理方法。与大多数现有的增强 CNN 分层多尺度表示能力的方法不同,我们改进了更精细的多尺度表示能力水平。为了实现这个目标,我们用一组更小的滤波器组来替换 n 通道中的个滤波器 1,每个滤波器组均用 w 通道(在不损失通用性的情况下,我们使用 n=sxw)。如图 2 所示,这些较小的过滤器组以类似残差的层次结构连接,以增加输出特性可以表示的规模。具体来说,我们将输入特征映射分成几个组。一组滤波器首先从一组输入特征映射中提取特征。前一组的输出特性将单独与另一组输入特性映射一起发送到下一组过滤器。此过程重复多次,直至所有输入功能映射均被处理。最后,将所有组的特征映射连接起来,并发送给另一组个过滤器,以完全融合信息。当等效接收场通过一个滤波器时,等效接收场随着输入特征转化为输出特征的任何可能路径而增大,由于组合效应导致许多等效特征尺度的产生。

图 1:多尺度表示对于各种视觉任务是必不可少的,例如感知目标对象的边界、区域和语义类别。即使对于最简单的识别任务,从非常不同的尺度感知信息对于理解部件、物体(例如,本例中的沙发、桌子和杯子)及其周围的上下文(例如,在桌子上下文有助于识别黑点)至关重要。

Res2Net 策略公开了一个新的维度,即 scale(Res2Net 块中特征组的数量),它是除深度 [37]、宽度[2] 和基数[43]。 现有维度之外的一个基本因素。我们在章节中声明。4.4 增加规模比增加其他方面更有效。

请注意,建议的方法在更细粒度的水平上开发多尺度潜力,这与现有的利用逐层操作的方法是正交的。因此,建议的构建模块,即 Res2Net 模块,可以很容易地插入到许多现有的 CNN 架构。广泛的实验结果表明,Res2Net 模块可以进一步提高最先进的 CNN 的性能,例如 ResNet 17、ResNeXt 43 和 DLA 47。

图 2:瓶颈块和建议的 Res2Net 模块之间的比较(标度尺寸 )。

2.相关工作

2.1 骨干网络

近年来见证了众多的骨干网[9]、[17]、[20]、[22]、[37]、[39]、[43]、[47],以更强的多尺度表示实现了各种视觉任务的心境性能。根据设计,CNN 具有基本的多尺度特征表达能力,因为输入信息遵循从粗到精的方式。AlexNet 22与传统的视觉识别方法相比,滤波器具有更好的性能。然而,由于网络深度和滤波器核大小的限制,AlexNet 只有一个相对较小的接受域。VGGNet 37 增加了网络深度并使用了内核更小的过滤器。较深的结构可以扩大感受野,这有助于从更大尺度上提取特征。与使用大核相比,通过堆叠更多的层数更容易扩大感受野。因此,VGGNet 提供了比 AlexNet 更强的多尺度表示模型,参数更少。然而,AlexNet 和 VGGNet 都是线性拓扑结构中的堆栈滤波器,这意味着这些网络只能有一个相对不灵活的感受野,并且在处理小范围尺度的对象时是最优的。

GoogLeNet [39] 利用具有不同内核大小的并行过滤器来增强多尺度表示能力。然而,由于计算资源的限制,GoogLeNet 中的内核不容易被进一步富集。因此,GoogLeNet 的多尺度表示方案仍然不能覆盖大范围的感受野。Inception 在 GoogLeNet 中的并行路径的每个路径中都有[38]、[40] 个堆栈更多的过滤器,以进一步扩展接受域。另一方面,ResNet [17] 引入了到神经网络的短连接,从而缓解了梯度消失,同时获得了更深的网络结构。在特征提取过程中,短连接允许卷积算子的不同组合,从而产生大量等价的特征尺度。同样,DenseNet [20] 中密集连接的层使网络能够在非常广泛的范围内处理对象。DPN [6] 将 ResNet 与 DenseNet 相结合,实现了 ResNet 的特征重用能力和 DenseNet 的特征探查能力。最近提出的 DLA[47] 方法结合了树结构中的层。层次树结构使网络具有更强的分层多尺度表示能力。

2.2 视觉任务的多尺度表示

CNN 的多尺度特征表示对于包括对象检测 [33]、显著对象检测 [18] 和语义分割[3] 在内的许多视觉任务具有重要意义,提高了这些领域的模型性能。

2.2.1 对象检测。

有效的 CNN 模型需要在场景中定位不同尺度的对象。早期的作品如 R-CNN [12] 主要依靠骨干网,即 VGGNet [37],来提取多尺度的特征。He 等人提出一种 SPP-Net 方法 [16],利用主干网后的空间金字塔池增强多尺度能力。快速的 R-CNN 方法 [33] 进一步提出了区域提议网络来生成各种尺度的边界框。基于更快的 R-CNN,FPN [25] 方法引入特征金字塔从单幅图像中提取具有不同尺度的特征。SSD 方法 [28] 利用不同阶段的特征图来处理视觉。

2.2.2 语义分割

提取对象的基本上下文信息需要 CNN 模型在不同的尺度上处理特征,以便进行有效的语义分割。Long 等人[30] 提出了一种最早的方法,能够使全卷积网络 (FCN) 的多尺度表示用于语义分割任务。在 DeepLab 中,Chen 等人[3]、[4] 引入级联卷积模块,在保持空间分辨率的同时,进一步扩展接收区域。最近,全局上下文信息通过 PSPNet [51] 中的金字塔池方案从基于区域的特征聚合。

2.2.3 突出的物体检测

精确定位图像中的显著对象区域需要理解用于确定对象显著性的大规模上下文信息,以及用于精确定位对象边界的小规模特征。早期的方法[2] 利用手工制作的全局对比度 [7] 或多尺度区域特征的表示 [41]。Li 等人[23] 提出了最早的方法之一,使多尺度深度特征的突出目标检测。之后,提出了多上下文深度学习[53] 和多级卷积特征[49] 来改进显著的目标检测。最近,Hou 等人引入阶段间密集的短连接,在每一层提供丰富的多尺度特征地图,用于突出的对象检测。

3 .Res2Net

3.1 Res2Net 模块

图 2 (a) 所示的瓶颈结构是许多现代主干 CNN 体系结构(例如 ResNet 17、ResNeXt 43 和 DLA 47)中的基本构建块。我们没有像在瓶颈块中那样使用一组个滤波器来提取特征,而是寻求具有更强多尺度特征提取能力的替代架构,同时保持相似的计算量。特别地,我们用更小的滤波器组替换了一组 个滤波器组,同时以层次化的类剩余样式连接不同的滤波器组。由于我们提出的神经网络模块涉及单个残差块内类似残差的连接,我们将其命名为 Res2Net。

图 2 显示了瓶颈块和建议的 Res2Net 模块之间的差异。在卷积以后,我们均匀地划分了特征地图进 s 特征地图子集,由 表示,其中 i属于{1,2,hellip;hellip;,8}。与输入特征图相比,每个特征子集 具有相同的空间大小,但通道数量为。除外,每个都有一个相应的卷积,用 表示。我们用表示 的输出。添加特征子集和输出。

(1)

请注意,每卷积运算符都可能从所有特征分割接收特征信息。每次特征分割 通过一个卷积算子,输出结果可能比有更大的感受野。由于组合爆炸效应,Res2Net 模块的输出包含不同数量和不同组合的感受野尺寸尺度。

在 Res2Net 模块中,以多尺度方式处理拆分,有利于全局和局部信息的提取。为了更好地融合不同尺度的信息,我们将所有的分割进行级联,并通过一个的卷积。分离和串联策略可以更有效地强制卷积来处理特征。为了减少参数的数量,我们省略了第一次分割的卷积,这也可以视为特征重用的一种形式。

图 3:Res2Net 模块可以与 dimension cardinality [43](将 conv 替换为组 conv)和 SE [19] 块集成

在本工作中,我们使用 s 作为标度维的控制参数。较大的 s 通常对应于更强的多尺度能力,由连接引入的计算内存开销可以忽略不计。

3.2 与现代模块的集成

近年来提出了许多神经网络模块,包括 Xie 团队引入的基数维。[43],以及 Hu 等提出的挤压和兴奋 (SE) 阻滞[19].所提出的 Res2Net 模块引入了与这些改进正交的比例尺寸。如图 3 所示,我们可以很容易地将基数维 [43] 和 SE 块 [19] 与建议的 Res2Net 模块集成在一起。

3.2.1 维度基数。

维度基数指示筛选器[43] 中的组数。该维数将单支滤波器转换为多支滤波器,提高了 CNN 模型的表达能力。在我们的设计中,我们可以用 3 x 3 基团卷积来代替 3 x 3 卷积,其中

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[18364],资料为PDF文档或Word文档,PDF文档可免费转换为Word