英语原文共 9 页,剩余内容已隐藏,支付完成后下载完整资料

在多个监督和非监督模型中基于图像的一致性最大化

摘要

诸如装袋,提升和模型平均的整体分类器已知在单个模型上具有改进的准确性和坚固性。然而,它们的潜力在没有访问原始数据的应用程序中有限,而是在元级模型输出中。在本文中,我们研究从多个监督和无监督模型输出的集合学习,一个主题,其中很少的工作已经完成。虽然无监督模型(例如聚类)不直接为每个个体生成标签预测,但它们为一组相关对象的联合预测提供了有用的约束。我们建议通过最大化监督预测和无监督约束之间的共识来巩固分类解决方案。我们将这个集合任务作为二分图上的优化问题,其中目标函数有利于图上的预测的平滑性,以及惩罚与由监督模型提供的初始标记的偏差。我们通过在相邻节点之间迭代传播概率估计来解决这个问题。我们的方法也可以解释为在变换空间中进行约束嵌入,或者在图上排名。三个实际应用的实验结果证明了所提出的方法相对于现有替代方案的益处。

1.介绍

我们试图合并多个信息源的知识,诸如装袋,提升和模型平均的传统集成分类器已知在单个模型上具有改进的准确性和坚固性。然而,它们的潜力在没有访问原始数据的应用程序中有限。例如,由于隐私,公司或者机构不会愿意提供原始数据,只会给他们的最终模型。所以信息融合需要在决策层进行。 此外,不同的数据源可以具有不同的格式例如,基于图像,音频和文本特征的web视频分类。 在这些情况下,我们必须在较粗糙的级别(预测类标签)合并不兼容的信息源而不是从原始数据学习联合模型。

在本文中,我们考虑组合多个监督和非监督的输出的一般问题模型提高预测精度。虽然无监督模型,如聚类,不直接生成标签预测,它们为分类任务提供有用的约束。理由是在同一集群中的对象应该更可能接收相同的类标签比不同集群中的类标签。此外,纳入无监督的聚类模型到分类集合中改进了基本模型的多样性,因此具有潜力提高预测精度。

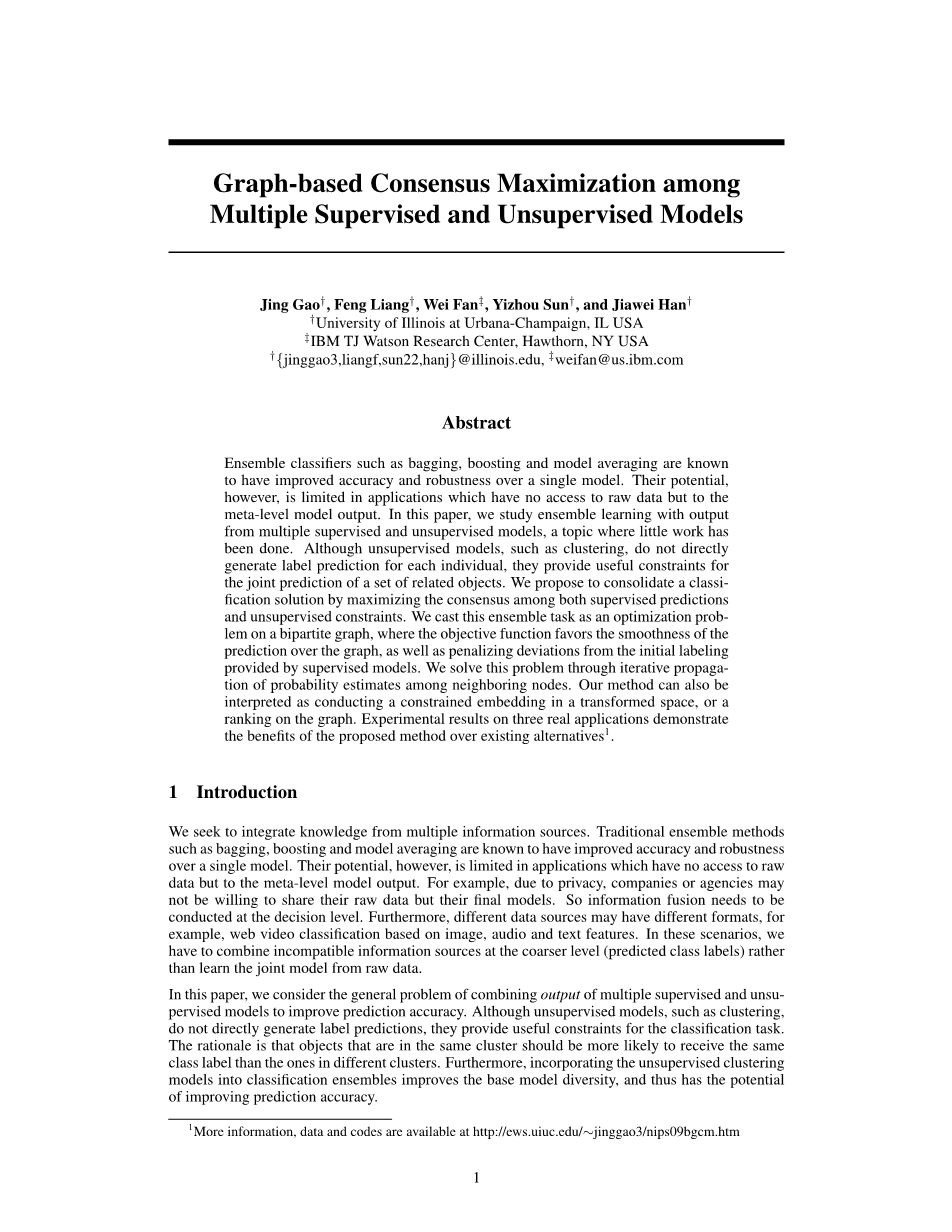

图1: 组 图2: 双向图 图3: 一致性最大化的位置

假设我们有一组来自c类的数据点X = {x1,x2,...,xn}。有m个模型提供关于X的分类的信息,其中第一个r是(监督的)分类器,剩余的是(无监督的)聚类算法。考虑其中X = { ,..., },c = 3和m = 4的示例。四个模型的输出是:M1 = {1,1,1,2,3,3,2} M2 = {1,1,2,2,2,3,1} M3 = {2,2,1,3,3,1,3} M4 = {1,2,3,1,2,1,1}

其中 和 为每个对象分配类标签,而 和 简单地将对象分成三个簇并且为每个对象分配簇ID。 每个模型,无论是监督还是非监督,将X分成组,并且同一组中的对象共享相同的预测类标签或相同的集群ID。我们通过二分图来总结数据,模型和相应的输出。 在图中,左边的节点表示由m个模型输出的组,其中来自监督模型的一些标记的组,右侧的节点表示n个对象,并且如果对象被分配给组,则组和对象被连接 通过其中一个模型。对于上述玩具示例,我们示出从图1中的分类器和聚类模型获得的组以及图2中的组对象二分图。

目标是预测 isin;X的类标签,它与基本分类器的预测一致,同时尽可能满足聚类模型强制的约束。 为了在所有模型中达到最大共识,我们在二分图上定义了一个优化问题,其目标函数惩罚与基本分类器的预测的偏差,以及邻近节点之间的预测类标签的差异。 在玩具示例中,X的共识标签预测应该是{1,1,1,2,2,3,2}。

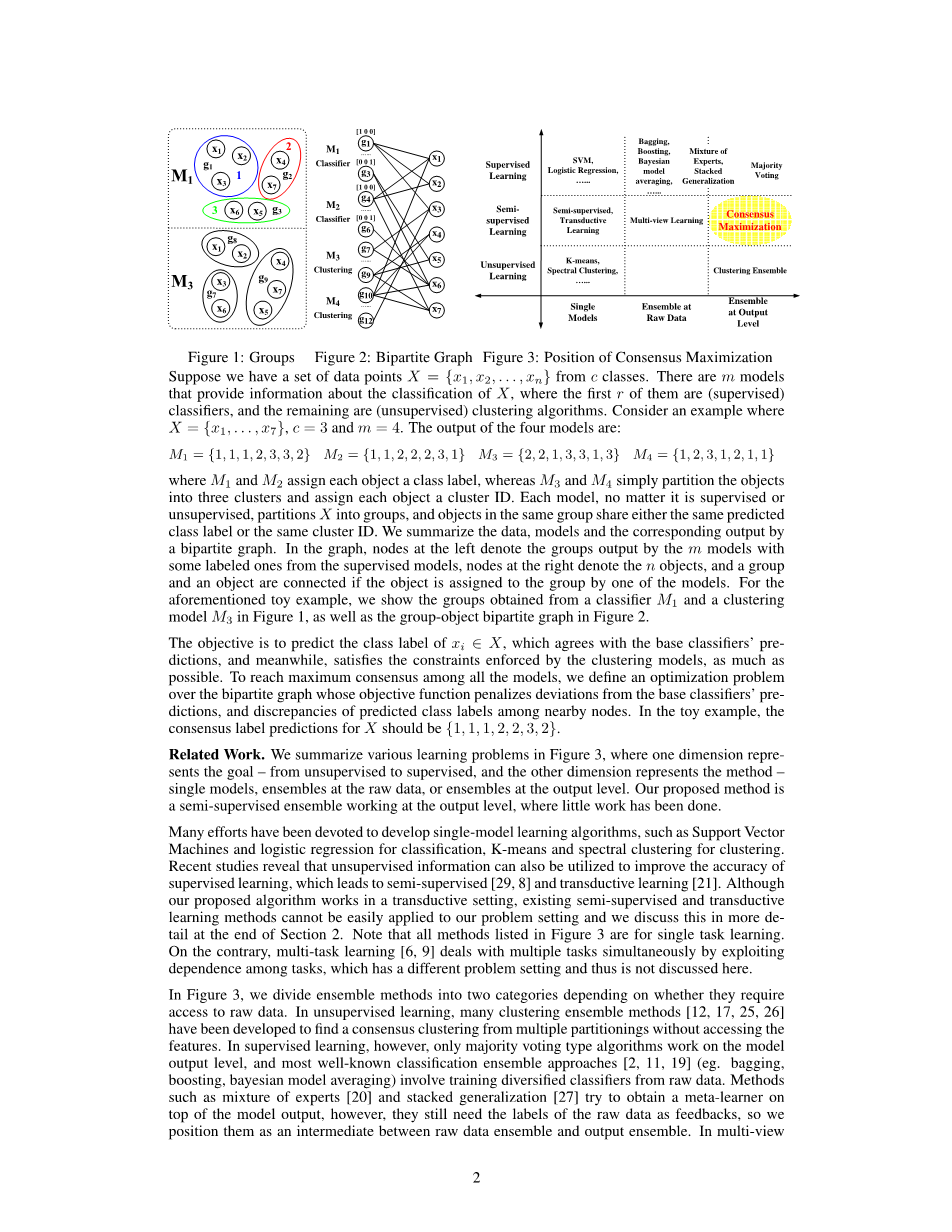

相关工作。 我们总结了图3中的各种学习问题,其中一个维表示目标 - 从无监督到监督,另一个维表示方法 - 单个模型,原始数据的合奏或输出级的合奏。 我们提出的方法是在输出级别工作的半监督集合,在那里做了很少的工作。

已经致力于开发单模型学习算法,例如支持向量机和用于分类的逻辑回归,用于聚类的K均值和频谱聚类的许多努力。 最近的研究表明,无人监督的信息也可以用于提高监督学习的准确性,这导致半监督[29,8]和转导学习[21]。 虽然我们提出的算法工作在一个转换设置,现有的半监督和转换学习方法不能轻易应用于我们的问题设置,我们在第2节结束时更详细地讨论这一点。请注意,图3中列出的所有方法是 单任务学习。 相反,多任务学习[6,9]通过利用任务之间的依赖性同时处理多个任务,这具有不同的问题设置,因此这里不讨论。

在图3中,我们将系综方法分为两类,取决于它们是否需要访问原始数据。在无监督学习中,已经开发了许多聚类集合方法[12,17,25,26],以在没有访问特征的情况下从多个分割找到共有聚类。然而,在监督学习中,只有多数投票型算法在模型输出水平上工作,并且最着名的分类集合方法[2,11,19](例如装袋,提升,贝叶斯模型平均)涉及从原始数据。诸如专家混合[20]和堆积泛化[27]等方法试图在模型输出之上获得元学习器,然而,他们仍然需要原始数据的标签作为反馈,因此我们将它们定位为中间原始数据集合和输出集合之间。在多视图学习[4,13]中,从来自多个源的标记和未标记数据学习联合模型。因此,它可以被认为是需要访问原始数据的半监督系综。

总结。提出的共识最大化问题是一个具有挑战性的问题,不能通过简单的多数表决来解决。 为了实现各种模型之间的最大一致性,我们必须寻求目标对象的全局最优预测。 在第2节,我们正式定义基于图的共识最大化问题,并提出一个迭代算法来解决它。 所提出的解决方案在相邻节点之间传播标记信息,直到稳定。 我们还对第3节中提出的方法提出了两种不同的解释,并讨论了如何将从几个标记的目标对象获得的反馈结合到第4节的框架中。第5节中进行了广泛的实验研究, 提出的方法在20个新闻组,Cora研究论文和DBLP出版物数据集上进行了说明。

2.方法论

假设我们有r个分类算法和(m-r)个聚类算法对于一个数据集合X的输出。出于简便的关系,我们假设每个点或者在m个算法中的每个群被分配到仅仅一个类别,并且每个聚类算法里包含C个群,与类的数目相同。注意到群的标号Z可能和类Z不相关。所以每一个基础算法把X分割到c个组里,一共有v=mc个组。其中第一个s=rc的组是由分类器产生的,剩下的V-S个组是来自聚类算法。在进一步进行之前,我们介绍一些将要在下文用到的符号:Bntimes;m 代表一个ntimes;m 的矩阵,其中bij 代表第ij个入口,向量Bi和Bj分别代表i行和j列。重要标志的总结见表1.

我们用图2所展示的双边图来代表对象和组,其中对象x1,...,xn 在右边,组g1,...,gv 在左。这个图中的关联矩阵Antimes;v 总结了m个算法对于X的输出:

如果xi 被其中的一个算法分配到组gj ,aij = 1;否则为0。

我们旨在预估每个对象节点xi属于c类的条件概率。作为一个多余参数,每个组节点gj 的条件概率也是预估的。对象节点的条件概率被记为Untimes;c ,组节点的条件概率被记为Qvtimes;c :

uiz = Pcirc;(y = z|xi) ; qjz = Pcirc;(y = z|gj).

由于起初 s=rc个组是从被监督的学习模式获得的,他们有一些最初的类标签记为Yvtimes;c ,其中:

如果gj 的预测标签是z,j=1,hellip;.s, yjz = 1; 否则为0。

使,并且我们就下文图中的优化问题形成一个共识:

其中||.|| 和 |.|分别代表向量L2和L1的范数。第一项保证了如果一个对象xi 通过其中一个算法被分配到组gj ,他们的条件概率的预估肯定相近。当j=1,hellip;.s,组节点gj 来自分类器,所以kj = 1 和第二项产生了限制,即一个组gj 的公识类标签预估不应和它最初类标签的预测偏离太远。alpha; 是对于打破限制的影子价格付款。当j = s 1,...,v, gj 是来自未被监督而且没有限制的模型的一个组,因此kj = 0 ,限制的权重也为0。最后,向量Ui和Qj是概率向量,因此每个成分必须大于或等于0并且总和等于1。

我们提议用块坐标下降法解决这个问题,见算法一。在第t个迭代,如果我们修复U的值,目标函数就成为关于向量Qj的v成分的二次方的总和。相应的海塞矩阵是呈对角线状,项等于。因此它是完全的的凸面状并且nabla;q~j·f(Q,U(tminus;1)) =0 使得花费函数关于向量Qj唯一且总体最小。第二个等式,相似的,修复Q同样可以得到关于向量Ui的总体最小。

(2)

Table 1: 重要的符号

|

标记 |

定义 |

|

1,...,c 1,...,n 1,...,s s 1,...,v Antimes;v = [aij] Untimes;c = [uiz] Qvtimes;c = [qjz] Yvtimes;c = [yjz] |

类指标 组指标 被监视模型中的组指标 未被监视模型中的组指标 对象i在组j的指示器 对象i关于类z的概率 组j关于类z的概率 组j预测为类z的概率 |

算法一:BGCM算法

输入:组对象关联矩阵A,起始标签矩阵Y,参数alpha;和 ;

输出:共识矩阵U;

算法:

随机初始化U0,U1

t larr; 1

while ||Ut minus; Utminus;1|| gt; do

Qt = (ATUtminus;1 alpha;KvY )

Ut = Dn AQ return Ut

矩阵形式的修正的公式在算法一中给出。Dv = diag 和Dn = diag 充当归一化因数。Kv = diag 表示在组节点上存在限制。在每个迭代期间,每个组节点概率的评估(例如Q)接收到来自邻对象节点的信息,同时获得初始值Y。做为回报,组节点更新后的概率评估当它的邻对象节点在更新U的时候传回消息。这可以直接证明(Q(t),U(t))汇聚到一

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[484306],资料为PDF文档或Word文档,PDF文档可免费转换为Word