英语原文共 9 页,剩余内容已隐藏,支付完成后下载完整资料

基于卷积神经网络的视频序列火焰检测方法

摘要:近年来,卷积神经网络(CNN)由于其高精度的识别率而在广泛的应用中成为活跃的话题。然而,如何可靠而有效地解决火焰检测的问题在实践中仍然是一个具有挑战性的问题。 在本文中,我们通过处理由监视场景的普通摄像机生成的视频数据,提出了一种基于CNN的实时火焰检测算法。首先,为提高识别效率,提出了一种候选目标区域提取算法来处理可疑火焰区域。其次,利用基于CNN的深度神经网络模型对候选区域的特征图进行分类。最后,通过分类结果获得相应的报警信号。 实验结果表明,该方法可以有效地识别火灾,并在自制数据库中达到较高的报警率。 该方法可以在实际中有效地实现火灾预警的实时性。

关键词:卷积神经网络;火焰检测;特征图;深度学习

1引言

传统的点烟和火探测器通常通过电离或光度法检测温度和烟和火产生的某些颗粒的存在。但是,除非温度和微粒到达传感器以激活它们,否则不会发出警报。此外,许多这样的检测器在大空间和室外环境中可能无法有效地检测。因此,火灾是最常见的事件之一,在尽早发现火灾的过程中,发现火灾比起其他任何事情都极其重要,以最大程度地减少人员伤亡和财产损失。根据中国九原庄北网站(JYZBW)2017年的报告,仅在中国发生了205起大火,造成217万起损失,263起平民火灾,这只是公共统计。随着计算机性能和视频处理技术的飞速发展,替换标准火焰探测器的趋势非常明显。 与现有的传感器相比,基于视频的火灾探测(VFD)可以有效减少探测时间,因此有效的VFD方法已成为现代监控系统中的热门话题。

为了有效地实时检测火灾,传统的火焰识别算法大多采用颜色,形状,纹理和运动等手动功能。但是,提取单一特征的火焰不能满足较高的火焰探测率。 一些研究人员提出了许多基于多功能的火焰检测模型和算法。为了提高概率方法在火焰检测中的性能,基于颜色和运动特征,提出了一种改进的概率模型,可以更合理地生成候选火形状。为了提高视频火灾的检测率,提出了一种基于颜色和运动模型且没有静态背景的鲁棒性火灾检测算法,证明了在不同火灾场景下的火灾检测率都令人满意。为了减少误报次数,提出了一种基于颜色和纹理特征的火焰检测新算法,可以保证对正样本的准确分类。但是,大多数手动功能没有平移,缩放和旋转的不变性。 而且,火焰在不同的外部条件下,尤其是在光照,风,燃烧器和与摄像机的距离不同的情况下,差异很大,因此大多数手动特性是在某些情况下根据统计数据设计的。

如今,各种深度学习算法已广泛应用于许多应用中,例如反向传播(BP),贝叶斯神经网络(BNN)和卷积神经网络(CNN)。为了增强火灾视频的检测性能,一些专家使用深度学习模型来提取用于检测视频序列中火灾的有用功能。 为了有效识别野火烟雾,提出了一种基于BP的烟雾检测方法,可以提高火焰预警的准确性。针对数学模型难以描述的火灾问题,提出了一种基于模糊神经网络的火灾检测模型,使火灾信号处理具有自学习和自适应能力。为了提高火焰预警的准确性,提出了一种CNN模型来识别火灾和烟雾视频。而且,CNN被证明可以在较少参数的情况下在火警视频上实现更好的性能。由于CNN的优势,我们在早期阶段就对CNN进行了广泛的火焰检测研究。 本文的主要贡献概括如下:

- 考虑到识别效率,提出了一种基于RGB模型的候选目标区域提取算法,用于处理可疑火焰区域。

- 为了实现更高的火焰检测报警率,通过基于CNN的神经网络对归一化的候选火灾特征图进行分类。

- 与我们以前的研究相比,提出的框架提高了火灾探测的准确性,并减少了误报的数量。

本文的结构是:第2节介绍了火焰视频图像数据库,第3节介绍了火灾特征的提取和分类,第4节提供了实验结果,讨论和结论如下: 在第5节中给出。

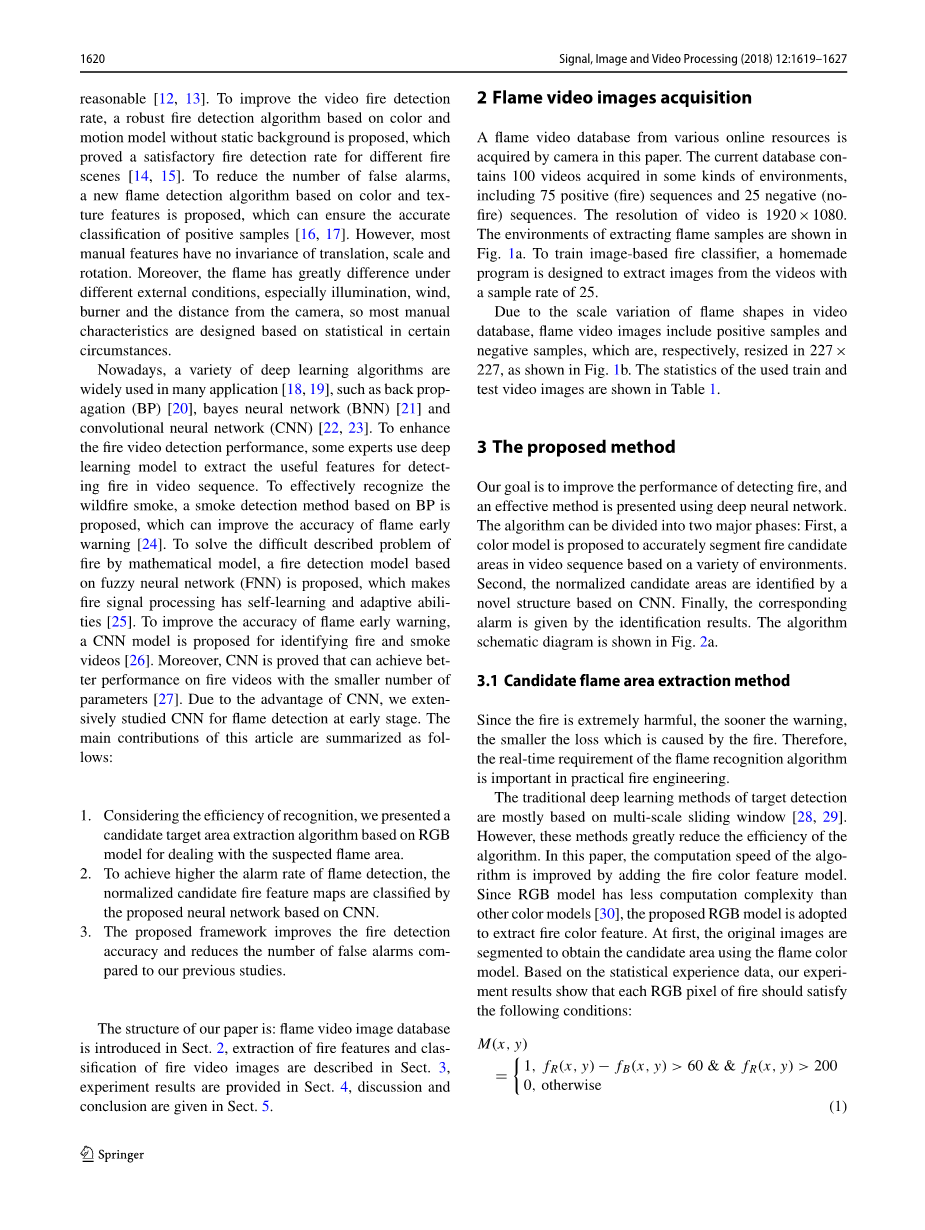

2火焰视频图像采集

本文通过摄像头从各种在线资源中获取火焰视频数据库。 当前数据库包含在某些环境中获取的100个视频,包括75个正(开火)序列和25个负(不开火)序列。视频的分辨率为1920times;1080。 提取火焰样品的环境如图1a所示。 为了训练基于图像的火灾分类器,设计了一个自制程序来从视频中提取图像,采样率为25。

由于视频数据库中火焰形状的尺度变化,火焰视频图像包括正样本和负样本,它们分别以227times;227的尺寸进行了调整,如图1b所示。 表1中显示了使用的火车和测试视频图像的统计信息。

3方法

我们的目标是提高火灾探测的性能,并提出一种使用深度神经网络的有效方法。 该算法可以分为两个主要阶段:首先,提出了一种颜色模型,可以根据多种环境在视频序列中准确分割火灾候选区域。 其次,通过基于CNN的新颖结构来识别归一化候选区域。最后,相应的警报由识别结果给出。 算法原理图如图2a所示。

3.1候选火焰面积提取方法

由于火灾极为危险,因此预警越早,火灾造成的损失就越小。因此,火焰识别算法的实时性要求在实际的消防工程中很重要。传统的目标检测深度学习方法大多基于多尺度滑动窗口。但是,这些方法大大降低了算法的效率。 通过增加火色特征模型,提高了算法的计算速度。由于RGB模型的计算复杂度比其他颜色模型要小,因此采用了建议的RGB模型来提取火色特征。 首先,使用火焰颜色模型对原始图像进行分割以获得候选区域。 根据统计经验数据,我们的实验结果表明,火的每个RGB像素应满足以下条件:

M(x, y)

1, fR(x, y) minus; fB(x, y) gt; 60 amp; amp; fR(x, y) gt; 200

0, otherwise

在此,M(x,y)表示分段的颜色二值化掩码,f R(x,y)是通道R的值,f B(x,y)是通道B的值。然后,通过获得连接区域的外部矩形来提取神经网络的归一化候选区域,图3a中显示了具有不同外部场景的外部矩形区域的二值图像。

图1 火焰数据库的环境和样本。a提取火焰视频序列的环境。b正样本和负样本

3.2拟议的神经网络结构

众所周知,卷积神经网络的结构分为三部分:卷积层,池化层和全连接层。 这三个部分的功能分别是鲁棒的特征提取,特征维数减少和分类。根据CNN的结构,我们提出了一种新颖的卷积神经网络结构,它更适合于火灾探测。 提出的结构如图3b所示。

图2 算法方案和流程。a算法原理图。 b算法流程图

图3 火焰面积提取和神经网络示意图。 a具有不同外部场景的候选区域的图像(左:原始图像,右:基于色彩模式的二进制图像)。 b拟议神经网络的示意图

3.2.1卷积层

它是所提出的神经网络的核心。 为了有效区分火和像火一样分散注意力,这些层由矩形的神经元网格组成,这使分类更加可靠。 在卷积层中,基于RGB模型的火像经过三个卷积运算,内核大小分别为11times;11、5times;5、3times;3。众所周知,ReLU函数Phi;(x)具有单边抑制,激发边界宽和激活稀疏等优点,因此在每个卷积层之后采用ReLU函数Phi;(x),如图所示:

此处,max(·)表示0到x之间的较大值。

第一层中卷积核函数的可视化如图4a所示。 如图所示,第一层神经网络模型的卷积滤波器主要检测低阶特征,例如边缘,角度和曲线。 然后,以内核尺寸11times;11可视化第一层的卷积特征图,如图4b所示。 从右图可以看出,不同的特征被不同的滤波器检测到。

图4 第一层中的可视化。a卷积核函数。b左:原始图像,右:卷积特征图是通过不同的滤镜获得的

3.2.2汇聚层

在前三个ReLU函数Phi;(x)之后,将在池化层中对经过处理的数据进行下采样。 在这里,为了减少更多参数的开销,我们采用了一个最大池化窗口,其大小为3times;3。 为了提高所提出结构的泛化能力并避免出现拟合现象,在前两个汇聚层通过规范理论对数据进行了规范化。 归一化函数分别显示为:

||x||1 |x1| |x2| ···· |xn|

||x||2 (|x1|2 |x2|2 ···· |xn|2) 1/2

在此,||·|| 1和||·||| 2分别表示L1范数和L2范数,x表示候选火灾区域的卷积特征向量。

3.2.3全连接层

最后,在第三个池化层之后,完全连接的层的功能是级联火灾特征图像。 为了减少过度平滑现象,在最后两个ReLU函数Phi;(x)之后采用了丢弃方法。 它包括以一定的概率将所选层中每个隐藏神经元的输出设置为零

图5 不同方法的结果和比较。a基于建议的列车组和试验组方法的损失函数曲线。b基于提出的方法的测试精度曲线。c不同方法的比较结果

4实验结果与讨论

所提出的基于卷积神经网络(CNN)的算法是在标准台式机上以C语言和Caffemodel实现的,该台式机配备了Octa Core,CPU 3.6 GHz和8 GB RAM。 该方法的流程图在图2b中示出。

在训练神经网络模型的处理中,对卷积层的训练就是对一些卷积滤波器进行训练,这些卷积滤波器对独特模式具有很高的激活性,从而达到了CNN的目的。 卷积层越多,功能就越复杂。为了训练更好的卷积核并获得这些卷积核的更有效的组合方式,本文提出的模型获得了最优参数,然后通过最优参数对测试样本进行了有效分类。训练集和测试集的损失函数曲线如图5a所示。 从该曲线可以看出,随着训练和测试迭代次数的增加,损失函数全部减小,然后曲线趋于稳定。 测试精度曲线如图5b所示。从该曲线我们可以看到,随着训练迭代次数的增加,测试精度会提高,然后当迭代次数为50,000时,曲线达到最高精度,即97.64%。

在以前的研究中,使用不同的颜色空间提取火焰的颜色特征,这些方法取得了良好的效果。 但是,色彩空间转换和特征提取的过程过于复杂,无法满足实时性要求。由于基于近红外图像的火焰区域强度高,研究人员提出了许多基于近红外图像的火灾探测算法。 该方法减少了突出的干扰并获得了较好的效果,但是对硬件设备的要求更高。针对基于近红外视频图像的火焰检测的优势,研究人员提出了一种将可见视频图像的火焰特征与近红外视频图像的火焰特征相结合的双光谱火焰特征检测方法。 该方法可以有效消除分割区域中的小孔现象。

为了评估该方法的性能,将实验结果与同一场景中通过火焰检测方法获得的结果进行了比较,如图5c所示。 第一种识别方法基于彩色视频图像。 颜色模型在我们之前的研究中使用,显示为:

在此,R、G和B分别表示R通道,G通道和B通道的值。第二种识别方法是基于近红外视频图像,通过区域增长算法提取火焰区域,适用于火焰分割。 像素的选择规则如下所示:

在我们先前的研究中使用了第三种识别方法,该方法将前两种方法结合在一起,而后一种方法则被提出。 但是,前三种方法的火焰检测率远低于建议的检测率。 表2比较了不同方法的计算速度。

5结论与展望

本文提出了一种基于卷积神经网络的彩色火灾特征检测与识别新方案。 首先,通过提出的基于RGB的模型提取火灾图像的颜色特征以获得候选区域。 其次,提出了神经网络对归一化特征图进行分类。最后,通过卷积神经网络的分类结果得到报警信号,并对该神经网络的性能进行测试。 实验结果表明,基于RGB模型的准确性和效率,该算法在改善火色特征识别方面取得了优异的性能。

这项工作主要集中在火焰的检测上,相对较少地着重于着火的位置以及在站立下观察物体和场景的情况。 未来的研究可能只专注于通过神经网络架构来实现火灾的定位和检测,它可以用经验值代替提取可疑火焰区域的过程,并且我们应该进一步丰富数据库以确保实用性算法。

参考文献

[1] Kong, S.G., Jin, D., Li, S., Kim, H.: Fast fire flame detection in surveillance video using logistic regression and temporal smoothing. Fire Saf. J. 79, 37–43 (2016)

[2] Touml;reyin, B.U., Dedeo ˘glu, Y., Guuml;duuml;kbay, U., Cetin, A.E.: Computer vision based method for real-time fire and flame detection. Pattern Recogn. Lett. 27(1), 49–58 (2006)

[3] Muhammad, K., Ahmad, J., Baik, S.W.: Early fire detection using convolutional neural networks during surveillance for effective di

剩余内容已隐藏,支付完成后下载完整资料

资料编号:[238970],资料为PDF文档或Word文档,PDF文档可免费转换为Word